구글 포토는 어떻게 음식 사진을 검색할까

구글 포토라는 서비스가 있다. 휴대폰에 있는 사진이나 동영상을 저장해주는 클라우드 서비스로, 무한대의 저장공간을 무료로 제공해 인기가 많다.

구글 포토라는 서비스가 있다. 휴대폰에 있는 사진이나 동영상을 저장해주는 클라우드 서비스로, 무한대의 저장공간을 무료로 제공해 인기가 많다.

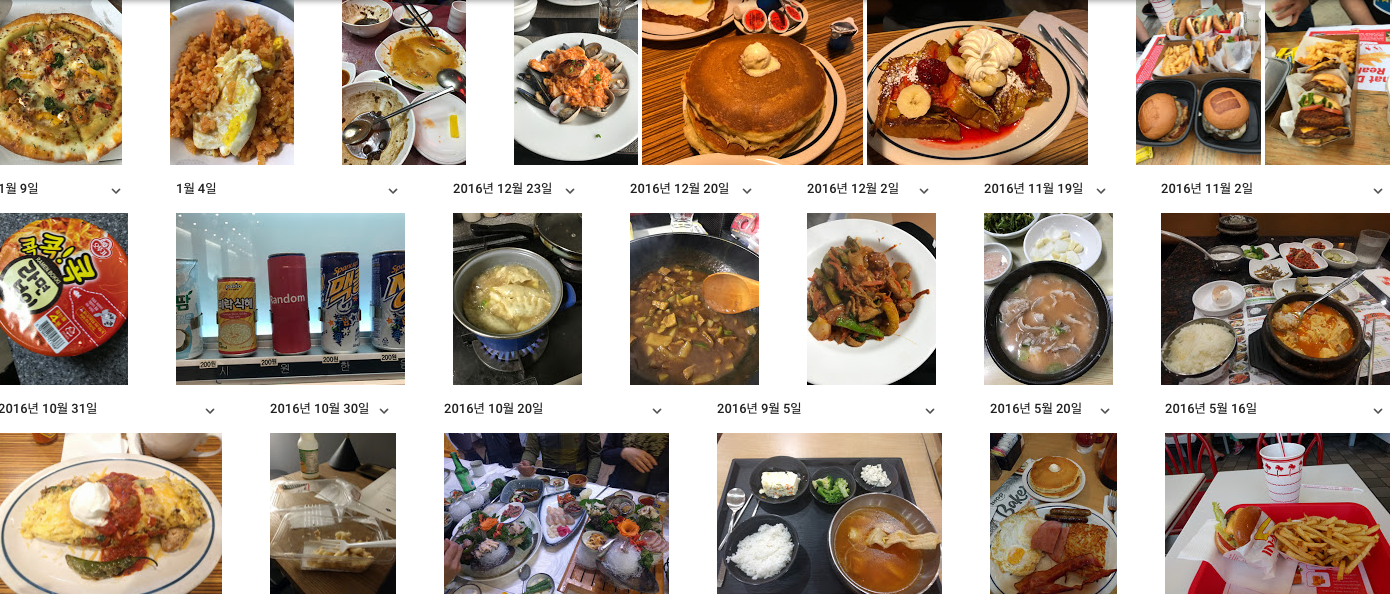

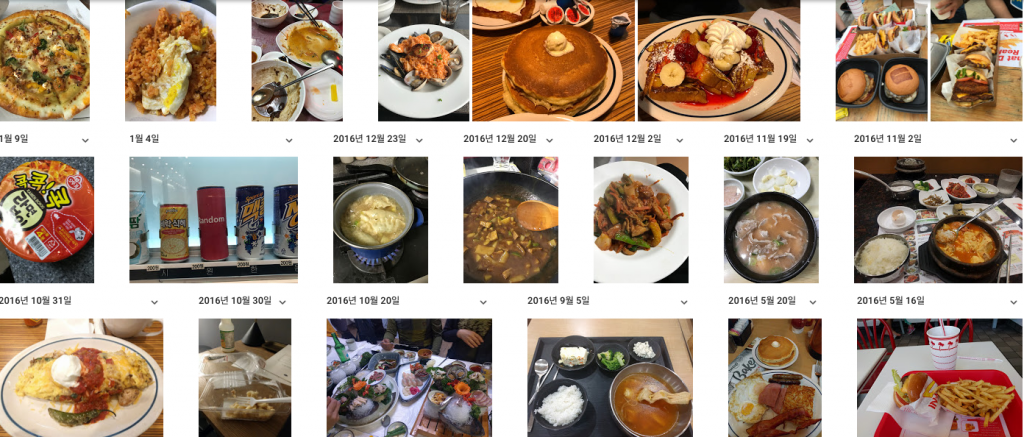

구글 포토의 또다른 장점은 검색 기능이다. 예를 들어 구글 포토에서 ‘음식’이라고 검색하면 그 동안 내가 찍었던 음식 사진들을 한 눈에 볼 수 있다.

그런데 이상하다. 구글 포토는 어떻게 음식 사진을 골라서 보여준 것일까? 내가 휴대폰으로 찍은 사진에 음식이라는 태그를 단 것도 아니고, 음식이라고 제목을 써놓은 것도 아니다. 보통 이미지 검색을 하면 사진의 제목이나 설명, 태그와 같은 메타데이터에 있는 내용을 검색한다.

그러나 음식이라는 단어는 어디에도 없다. 음식뿐 아니라 하늘이라고 검색하면 하늘이 보이는 사진이, 바다라고 검색하면 바닷가에서 찍은 사진이 나온다. 물론 메터데이터에는 하늘이나 바다라는 단어가 들어가 있지 않다.

♦컴퓨터가 이미지를 ‘보는’ 시대

지금까지 검색이란 텍스트를 대상으로 한 것이었다. 우리는 흔히 동영상, 음악, 이미지 등의 콘텐츠를 검색하지만, 그것은 그 콘텐츠 자체가 아니라 콘텐츠에 달려있는 제목, 설명, 태그 등 텍스트를 검색한 것이다.

귀여운 고양이가 많이 등장하는 동영상이라고 할지라도 제목이나 부제, 내용설명, 태그 등에 고양이라는 단어가 포함돼 있지 않으면 ‘고양이’라는 검색어로 검색되지 않는다. 반대로 ‘고양이 닮은 강아지’라는 제목이 달린 동영상은 고양이가 한 마리 등장하지 않아도 ‘고양이’라는 검색어에 검색된다.

때문에 멀티미디어 콘텐츠 검색은 어떻게 제목이나 태그가 달려있느냐가 품질을 좌우했다. 실제 이미지와는 관계가 없다. 이것은 멀티미디어 검색의 본질적인 한계였다. 컴퓨터가 사물을 ‘보지’ 못하기 때문에 벌어지는 일이다. 세 살짜리 어린아이도 개와 고양이를 구분하는데, 컴퓨터는 하지 못한다.

구글은 이런 문제를 해결하기 위해 오랫동안 노력해왔고, 인공지능을 통해 해법을 찾았다. 딥러닝을 통해 컴퓨터가 이미지를 스스로 분류하거나 태깅을 할 수 있다.

기존에는 고양이 사진을 컴퓨터가 인지하기 위해 어떤 ‘평균적인 고양이 이미지 값’을 가지고 있었다. 고양이 사진인지 아닌지 컴퓨터가 알려면 이미지 픽셸 정보를 보고 그 값을 기존에 정의된 고양이 값과 비교해 판단한다.

그러나 고양이의 종류는 무수히 많으며, 웅크린 모양, 조명, 상황 등에 따라 그 값은 얼마든지 달라질 수 있다. 이 때문에 기존의 방식으로는 컴퓨터가 고양이를 인지하도록 하는 것은 사실상 불가능했다.

하지만 딥러닝은 이런 문제를 해결할 수 있다. 컴퓨터는 무수히 많은 고양이 사진을 입력받아 학습한다. 이 사이에서 공통점을 스스로 찾아내는 방식이다. 구글은 ‘오픈 이미지 데이터셋’이라는 컴퓨터 시각(Vision) 연구용 데이터셋을 이용한다. 900만개가 넘는 이미지로 구성된 이 데이터셋은 구글과 카네기맬론대, 코넬대가 공동으로 구축했다.

닐 알드린 구글 소프트웨어 엔지니어(컴퓨터 비전 리서치 담당)는 “이미 구글 인공지능에 적용된 컴퓨터 비전 모델의 능력은 사람보다 뛰어난 부분도 있다”며, “수년 내에 구글의 컴퓨터 비전이 인간보다 사물과 풍경을 더 잘 구분하는 시대가 올 것”이라고 말했다.

♦구글은 동영상도 ‘본다’

구글은 이같은 컴퓨터 비전 기술을 동영상에까지 확장해 나가고 있다.

구글 클라우드의 최고 인공지능·머신러닝 과학자 페이페이 리는 이달 초 자사의 넥스트 클라우드 컨퍼런스에서 새로운 클라우드 비디오 인텔리전스 애플리케이션프로그래밍인터페이스(API)를 공개했다. 비디오에서 대상을 자동으로 인식해 검색할 수 있도록 하는 기술이다.

이를 이용하면 제목이나 태그에 고양이라는 단어가 포함돼 있지 않은 고양이 동영상을 ‘고양이’라는 검색어로 찾을 수 있다. 사물 인식 기능을 통해 구글 클라우드가 동영상에 등장하는 대상을 자동으로 태깅하고, 이를 검색하는 것이다.

컴퓨터 비전 기술이 동영상으로 확장되는 것은 매우 중요하다. 예를 들어 자율주행차는 앞에서 날아다니는 검정 비닐 봉투와 돌덩이를 구분해 내야 한다. 컴퓨터가 입력된 영상에 대한 인지 능력이 없으면 자율주행차는 실현 불가능하다.

또 시큐리티 카메라는 정상적인 거주자인지 침입자인지 구별할 수 있어야한다. 가족 구성원이 들어왔을 때는 경보를 울리지 않고 도둑이 들어오면 경보를 울려야 한다.

클라우드 비디오 인텔리전스 API는 구글의 텐서플로와 같은 인공지능 프레임워크를 사용하고, 개, 꽃, 사람 등 동영상에 등장하는 사물에 대한 명사 정보를 제공할 뿐 아니라 달리다, 헤엄치다, 날다 등의 동사에 대한 정보도 제공한다. 이는 ‘수영장에서 헤엄치는 강아지’와 같은 검색이 가능하다는 의미다. 구글은 향후 이 기술을 유튜브까지 확장할 계획이다.

클라우드 비디오 인텔리전스 API를 발표한 페이페이 리는 인공지능 분야에서 매우 유명한 인물이다. 스탠퍼드대 인공지능연구소(SAIL)와 시각인지연구소 소장을 역임하고 지난해 11월 구글이 그녀를 전격 영입했다.

페이페이 리는 이미지넷을 창시한 것으로 유명하다. 이미지넷은 컴퓨터가 사진을 보고 이해할 수 있도록 하는 프로젝트다. 약 10억 장의 이미지에 태그를 달아 컴퓨터가 사물의 차이를 이해할 수 있도록 학습시켰다. 구글이 이날 발표한 동영상 내에 등장하는 사물(동물, 사람 등)을 인지하는 기술은 결국 이미지넷의 확장판이라고 볼 수 있다.

글. 바이라인네트워크

<심재석 기자>shimsky@byline.network