인스타그램, 이해가지 않는 유해물 정책 ‘스트라이크 아웃’으로 변경

인스타그램에 ‘스트라이크 아웃’ 제도가 적용된다. 혐오 표현, 따돌림, 성적 행위, 약물 거래, 테러 등을 상징하는 게시물을 여러 번 게시하면 계정이 강제 비활성화되는 정책이다.

기존 인스타그램은 음란물이나 사이버불링 등 인스타그램 운영 정책(커뮤니티 가이드라인)을 위반하는 게시물이 있으면 삭제하고, 전체 게시물 중 유해 게시물 비율을 따져 계정을 강제 비활성화하는 방식이었다. 따라서 게시물 자체가 많으면 유해 게시물이 조금 늘어나도 문제가 없었다. 예를 들어 5개의 게시물을 올렸는데 3개의 게시물이 유해성 있을 때와, 1000개 게시물 중 3개 게시물을 올린 계정이 다르게 대접받았다. 이해가 가지 않는 정책이다.

바뀐 정책은 게시물 총량보다 기간에 중점을 둔다. 일정 기간 동안 유해 게시물을 정해진 횟수 이상 올리면 계정 소유자에게 비활성화 알림을 주고 이후 비활성화가 진행된다. 기간과 횟수는 밝히고 있지 않다. 이때 게시물 삭제가 부당하다고 생각하면 알림을 눌러 재심사를 요청할 수 있다. 예를 들어 수유나 예술 사진 등은 알고리즘 학습의 미완으로 인해 음란물로 ‘취급’된 사례가 있다.

유해 게시물은 AI와 사람이 직접 선별한다. AI가 주로 게시물 전체를 모니터링하며, 모니터링 요원도 게시물을 걸러낸다. 또한, 사용자들의 신고가 있는 게시물도 심사를 거쳐 혐오 게시물로 판단하고 처리할 수 있다.

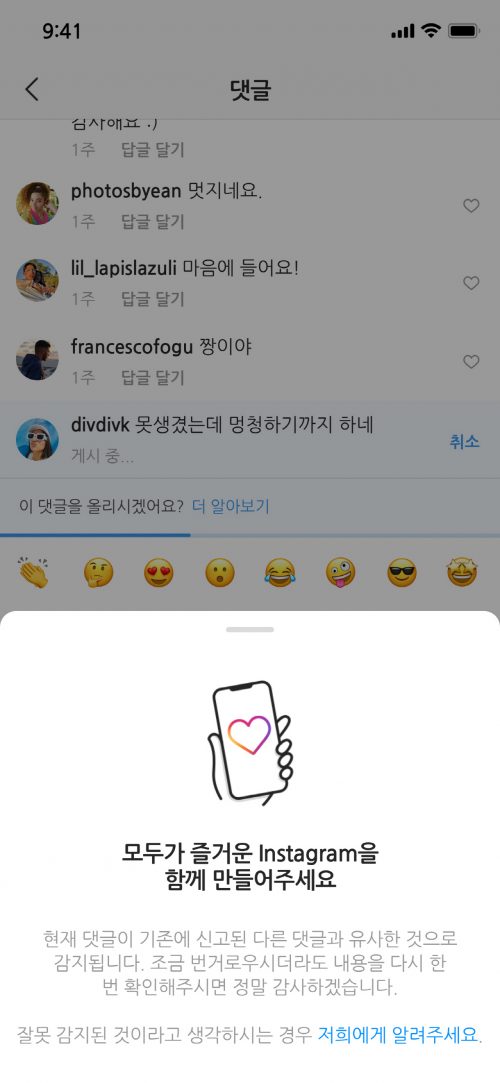

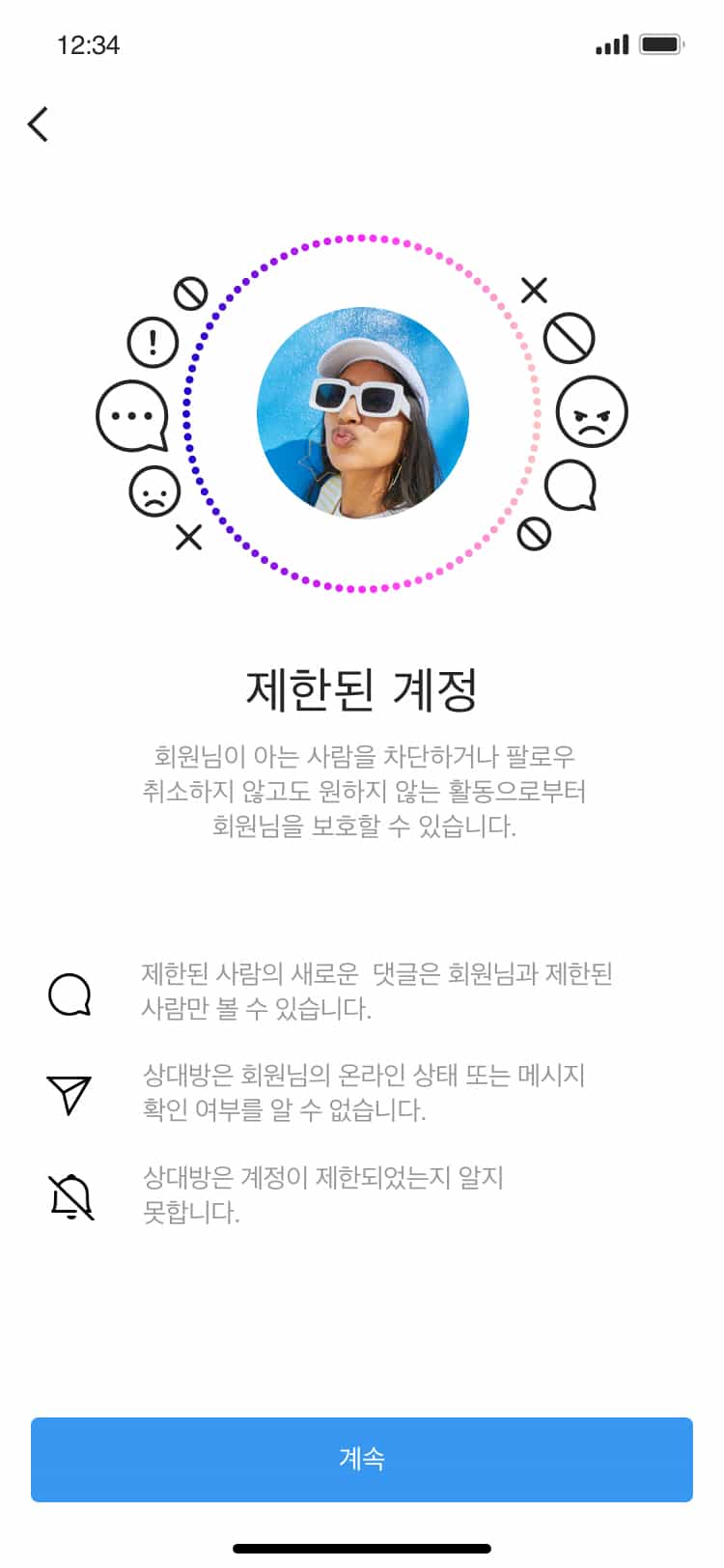

인스타그램은 지난 7월 9일 AI를 통한 댓글 취소 기능을 발표하기도 했다. 댓글을 달 때 부정적인 성향이 있으면 작성자에게 공격적으로 받아들여질 수 있다는 기능을 알려주는 것이다. 제한하기 기능을 통해 특정 사용자 계정에 게시물이 노출되지 않도록 할 수 있다. 이는 청소년이나 권력 관계에 있는 직장인에게 유용한 기능이다. 현재 접속 여부나 DM 확인 여부 등을 알려주지 않는다.

이러한 기능들은 대부분 인스타그램이 오래 연구해온 사이버 불링 방식에 대한 포괄적인 연구를 바탕으로 개발됐다. 페이스북에도 좀 적용하길 바란다.

글. 바이라인네트워크

<이종철 기자> jude@byline.network

[무료 웨비나] 아이덴티티 보안 없는 보안 전략은 더 이상 안전할 수 없습니다

◎ 일시 : 2025년 7월 15일 (화) 14:00 ~ 15:30

◎ 장소 : https://bylineplus.com/archives/webinar/53537