페이스북 코리아는 가짜뉴스를 거르지 않는다

페이스북이 자사 뉴스피드 정렬에 대한 방식을 일부 공개했다. 이 과정에서 가짜뉴스에 대한 입장도 밝혔다. 페이스북에서는 허위뉴스라는 말로 정의한다.

제목에서 가짜뉴스를 거르지 않는다고 언급한 건 거짓이다. 페이스북 코리아도 가짜뉴스를 걸러낸다. 제목을 그렇게 지은 이유는 지금 이 기사를 가짜로 만들기 위해서다. 여러분이 이 기사를 페이스북을 통해 읽었다면 1. 페이스북의 가짜뉴스 걸러내는 알고리즘이 똑바로 작동하지 않았거나, 2. 내용까지 판단할 수 있을 정도로 정교한 인공지능을 사용하거나, 3. 여러분이 바이라인네트워크의 훌륭한 독자인 세 가지 경우 중 하나에 해당될 것이다.

다음은 9월 5일 열린 페이스북 뉴스피드 미디어 세션 내용을 정리한 것이다.

페이스북의 뉴스피드 랭킹 정의 방식

페이스북은 사용자 간 의미 있는 상호작용(Meaningful Social Interaction)을 알고리즘의 근간으로 한다. 따라서 일반 페이지(비즈니스 계정)보다는 개인이나 그룹의 게시물을 더 많이 노출한다. 그렇다면 개인의 인기 있는 게시물은 어떤 로직으로 노출될까. 인벤토리, 시그널, 예측, 관련성 점수 네 단계를 통해서다.

인벤토리

인벤토리란 개인의 성향 집합체다. 개인 사용자가 맺은 페친과 팔로우하는 페이지나 그룹 등의 총합을 말한다. 이 인벤토리에 따라 시그널이 결정된다.

시그널

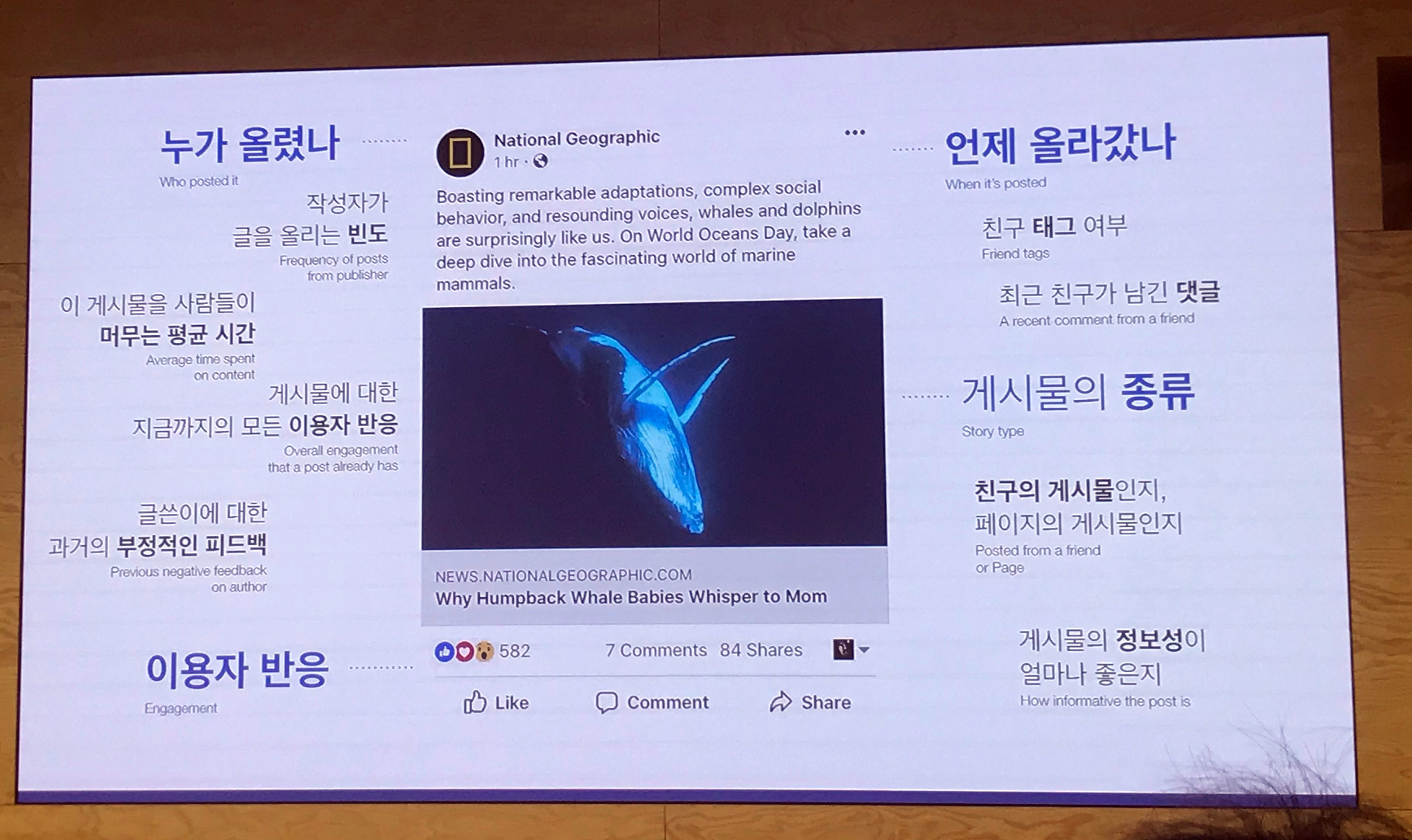

시그널은 페이스북 사용자 중 어떤 사람이 어떤 내용으로 어떤 컨텐츠를 언제 올렸는지를 말한다. 게시물의 발행정보라고 생각하면 된다.

예측

이 글은 시간 순서대로 게재되는 것이 아니라, 다른 사용자가 이 게시물에 반응할 가능성이 얼마나 되는지를 예측한 후, 적극적인 대화가 오갈 수 있도록 배치 조정된다.

관련성 점수

앞의 세 가지가 관련성 점수를 결정한다. 관련성 점수가 높은 것이 피드에 뜨는 것이다. 이 요소들은 페이스북이 할 수 있는 한 최대한 많은 소통이 일어나도록 작동한다. 이를 페이스북은 웰빙(Wellness)으로 정의한다.

시그널과 예측은 이 과정의 핵심이다. 컨텐츠를 사람들이 얼마나 좋아할까를 가늠하는 수단이 된다. 그러나 이는 반대로 생각하면 부정적 반응 예측도 가능하다는 의미가 된다.

부정적인 의견은 지우거나 도달 줄이기

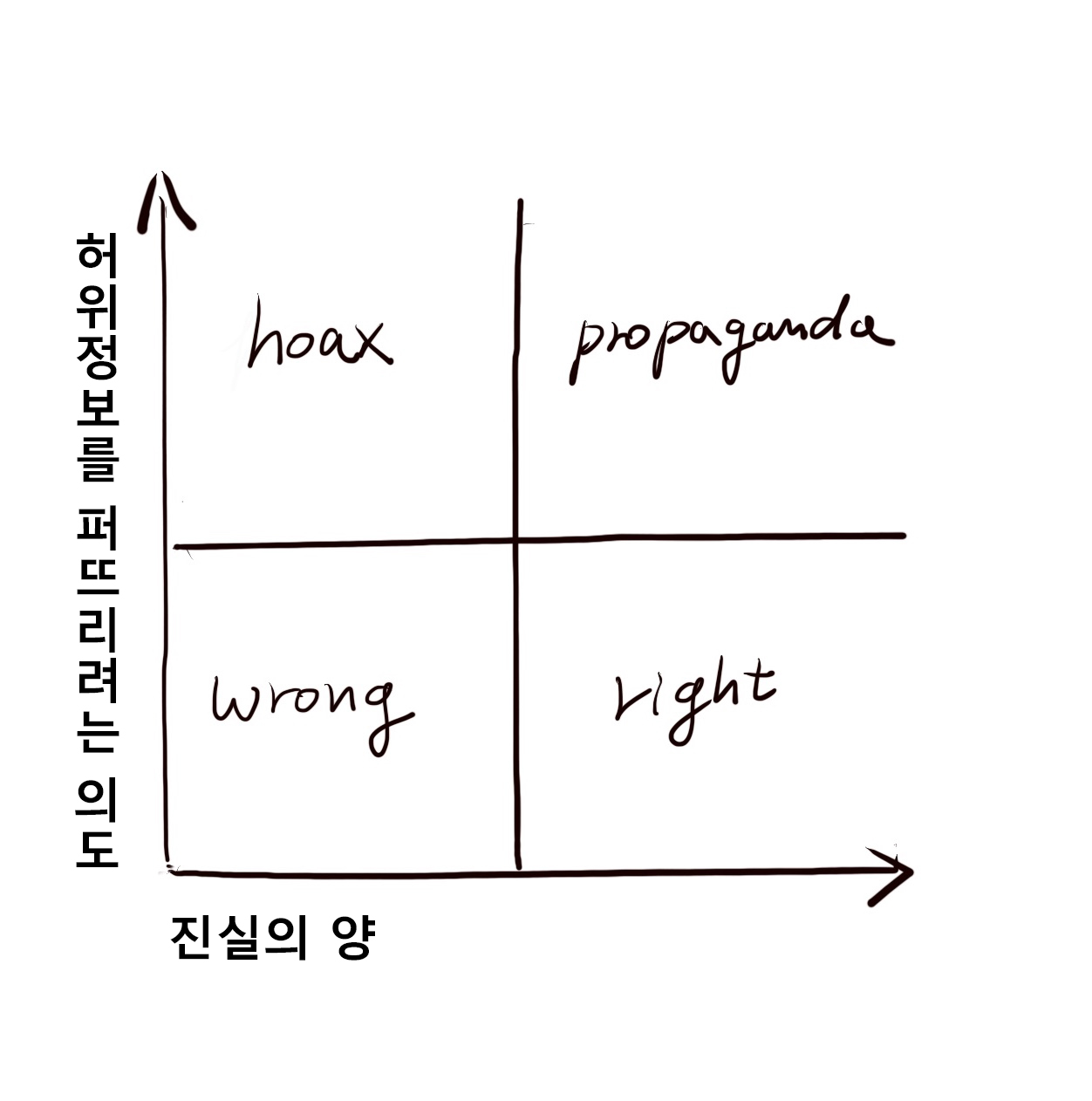

부정적인 의견은 우선 페이스북 커뮤니티 규정에 따라 삭제한다. 이를 페이스북은 사분면을 그려 판단하고 있다고 한다.

X축은 진실의 양, Y축은 허위뉴스를 만들려는 의도다. 이를 통해 사분면을 그려보자. 그렇다면 아래의 왼쪽은 진실도 없고 허위로 이야기를 퍼트리려는 의도도 없다. 이것은 거짓이다. 반대로 그 오른쪽은 진실의 양이 충분하고 허위로 이야기를 퍼뜨리려는 의도 역시 없다. 이것은 진실이다.

위의 경우 진실의 양이 부족한데, 허위로 이야기를 퍼트리려는 의도는 크다. 이는 가짜뉴스가 된다. 진실 총량이 많지만 허위로 이야기를 퍼뜨리려는 경우를 프로파간다로 정의한다.

이중 페이스북이 삭제하려 하는 것은 가짜뉴스다. 커뮤니티 규정에 따라 가짜 계정을 판단하고, 스팸을 제거하고, 허위인 사실을 앞세운 광고 및 상업적 게시물을 제거한다. 또한, 판단이 어려울 경우를 예측해 허위뉴스나 프로파간다에 가깝다는 판단을 내리면 그 게시물과 관련은 있지만 반대 입장인 글을 관련 글로 띄워 판단을 사용자 스스로 할 수 있도록 한다. 예를 들어 미국 어딘가에서 우주선이 발견됐다는 뉴스를 누가 올렸다고 치자. 그렇다면 그것이 우주인이 아니라는 뉴스도 관련 기사에 함께 등장한다.

만약 가짜뉴스로 판단이 되거나, 점차 허위가 되고 있다는 판단이 들면 이 게시물을 완전히 삭제하거나, 의심의 여지가 있을 경우 도달을 줄인다.

그렇다면 페이스북은 이 허위뉴스를 어떻게 판단할까? 스스로 입맛에 맞는 뉴스만 살려놓지는 않을까? 기자가 ‘페이스북은 멍청이’라는 문장을 이 기사 안에 넣어도 페이스북은 도달을 유지하려고 할까?

팩트 체크 기관의 판단

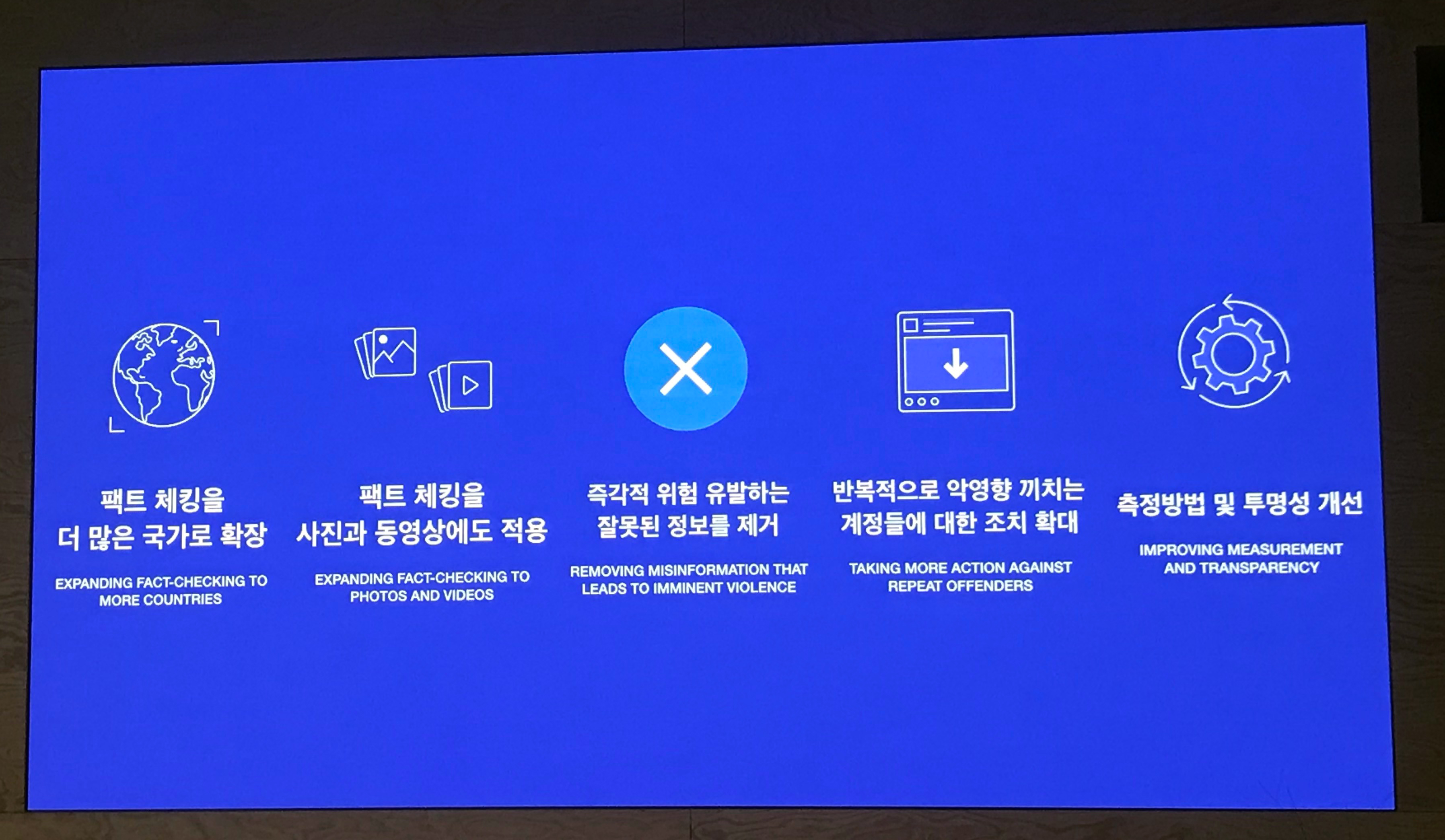

게시물의 진위여부는 페이스북이 직접 하는 것은 아니다. 국제 팩트체크 협회(IFCN, International Fact Checker Network)의 주관에 따라 판단한다. 과정은 1. 잠재적 가짜뉴스를 머신러닝을 통한 다양한 시그널로 식별하고, 팩트체킹 기관 역시 별도로 관련 내용을 선제적 검토한다 2. 팩트체커가 내용을 검토해 가짜라고 판단하거나 정확도에 점수를 매긴다 3. 판단되면 글을 지우거나 도달을 줄인다.

이 머신러닝은 가짜뉴스를 전파할 때, 반응할 때 어떠한 과정을 거치는지를 이해하고 적용된다. 또한, 텍스트로 된 포스팅 외에도 링크, 사진, 동영상에도 도입하려고 노력 중이라고 한다. 예를 들어 합성 이미지가 올라오면 이미지의 메타데이터를 파악해 합성임을 파악하는 등의 일(Reverse Image Data Search Tool)을 한다.

그렇다면, 반복적으로 악영향을 끼치는 계정들에 대해서는 어떻게 행동할까? 예를 들어 낚시성 제목을 써서 클릭해 들어가면 뉴스는 없고 광고만 붙어 클릭만을 유도하는 사기성 게시물(Click Bait)이라면? 확산을 줄이고 광고 클릭을 할 수 없게 하며, 수익화 기능(페이스북 광고를 뜻한다)을 실행할 수 없도록 한다.

그렇다면 가짜뉴스라고 말하긴 애매하지만 정치 입장차(좌-우) 등에 따라 가짜라고 서로 주장하는 게시물은 어떨까? 정치, 인권, 경제 등 입장에 따라 의견이 갈리는 것들에 대해서도 페이스북이 재단할 권한이 있을까?

댓글과 사용자 신고는 큰 영향을 주지 않는다

유독 사용자의 비방성 댓글이나 신고가 심한 게시물이 있다. 그것이 진실일 수도 아닐 수도 있다. 그렇다면 사용자들은 댓글과 신고를 많이 남기지만 팩트체커들에게 이는 영향을 주지 않는다. 페이스북에서도 팩트체커에게 전달할 머신러닝 내용으로 이 두 가지를 심각하게 다루지 않는다. 입장에 따라 달라지기 때문이다.

한국에도 팩트체커 도입이 가능할까

국내에는 IFCN과 같은 팩트체커 협회 가이드라인을 준수할 수 있는 기관이 현재는 없다. 따라서 방심위, 선관위 등의 정부 기관과 협력하고, 혐오성 글을 스스로 잡아내며, 범죄가 있을 때 범죄자를 잡아내는 데 도움을 줬다. 페이스북 코리아는 “한국에서는 허위뉴스가 심한 편은 아니라”며 “공인기관이 등장한다면 앞으로 팩트체크 과정을 함께 진행하겠다”고 밝혔다. 구체적인 시기는 직 정해지지 않았다.

멍청이인 페이스북은 이 기사를 얼마나 제대로 파악했을까. 가짜뉴스 양성소이자 유통기관인 페이스북은 이 기사가 가짜뉴스임을 파악하고 있는 것인가. 물론 가짜는 두 번째 문단과 마지막 문단뿐이다. 이 글이 많이 읽히지 않는다면 페이스북이 잘 하고 있고 사실 기사는 잘 썼다고 핑계를 댈 수 있다.

글. 바이라인네트워크

<이종철 기자> jude@byline.network

[무료 웨비나] 아이덴티티 보안 없는 보안 전략은 더 이상 안전할 수 없습니다

◎ 일시 : 2025년 7월 15일 (화) 14:00 ~ 15:30

◎ 장소 : https://bylineplus.com/archives/webinar/53537

페이스북 노출 여부를 떠나 이 기사는 아주 훌륭합니다~! 재밌게 잘 읽고 있습니다 ㅎㅎㅎ

감사합니다!